Robots.txt ఫైల్ అంటే ఏమిటి? మీరు SEO కోసం రోబోట్స్ ఫైల్ను వ్రాయడానికి, సమర్పించడానికి మరియు రీక్రాల్ చేయడానికి అవసరమైన ప్రతిదీ

మేము ఒక సమగ్ర కథనాన్ని వ్రాసాము శోధన ఇంజిన్లు మీ వెబ్సైట్లను ఎలా కనుగొనడం, క్రాల్ చేయడం మరియు సూచిక చేయడం. ఆ ప్రక్రియలో ఒక పునాది దశ robots.txt ఫైల్, మీ సైట్ను క్రాల్ చేయడానికి శోధన ఇంజిన్ కోసం గేట్వే. శోధన ఇంజిన్ ఆప్టిమైజేషన్లో robots.txt ఫైల్ని సరిగ్గా ఎలా నిర్మించాలో అర్థం చేసుకోవడం చాలా అవసరం (SEO).

ఈ సరళమైన ఇంకా శక్తివంతమైన సాధనం వెబ్మాస్టర్లు తమ వెబ్సైట్లతో శోధన ఇంజిన్లు ఎలా పరస్పర చర్య చేస్తారో నియంత్రించడంలో సహాయపడుతుంది. శోధన ఇంజిన్ ఫలితాల్లో వెబ్సైట్ యొక్క సమర్థవంతమైన ఇండెక్సింగ్ మరియు సరైన దృశ్యమానతను నిర్ధారించడానికి robots.txt ఫైల్ను అర్థం చేసుకోవడం మరియు సమర్థవంతంగా ఉపయోగించడం చాలా అవసరం.

Robots.txt ఫైల్ అంటే ఏమిటి?

robots.txt ఫైల్ అనేది వెబ్సైట్ యొక్క రూట్ డైరెక్టరీలో ఉన్న టెక్స్ట్ ఫైల్. సైట్లోని ఏ భాగాలను క్రాల్ చేయాలి లేదా చేయకూడదు అనే దాని గురించి శోధన ఇంజిన్ క్రాలర్లకు మార్గనిర్దేశం చేయడం దీని ప్రాథమిక ఉద్దేశ్యం. ఫైల్ రోబోట్స్ మినహాయింపు ప్రోటోకాల్ను ఉపయోగిస్తుంది (REP), వెబ్ క్రాలర్లు మరియు ఇతర వెబ్ రోబోట్లతో కమ్యూనికేట్ చేయడానికి ప్రామాణిక వెబ్సైట్లు ఉపయోగిస్తాయి.

REP అనేది అధికారిక ఇంటర్నెట్ ప్రమాణం కాదు కానీ పెద్ద శోధన ఇంజిన్లచే విస్తృతంగా ఆమోదించబడింది మరియు మద్దతు ఇస్తుంది. Google, Bing మరియు Yandex వంటి ప్రధాన శోధన ఇంజిన్ల నుండి డాక్యుమెంటేషన్ ఆమోదించబడిన ప్రమాణానికి దగ్గరగా ఉంటుంది. మరింత సమాచారం కోసం, సందర్శించండి Google Robots.txt స్పెసిఫికేషన్లు సిఫార్సు చేయబడింది.

SEOకి Robots.txt ఎందుకు కీలకం?

- నియంత్రిత క్రాలింగ్: Robots.txt వెబ్సైట్ యజమానులను సెర్చ్ ఇంజన్లు తమ సైట్లోని నిర్దిష్ట విభాగాలను యాక్సెస్ చేయకుండా నిరోధించడానికి అనుమతిస్తుంది. డూప్లికేట్ కంటెంట్, ప్రైవేట్ ప్రాంతాలు లేదా సున్నితమైన సమాచారంతో కూడిన విభాగాలను మినహాయించడానికి ఇది ప్రత్యేకంగా ఉపయోగపడుతుంది.

- ఆప్టిమైజ్ చేసిన క్రాల్ బడ్జెట్: శోధన ఇంజిన్లు ప్రతి వెబ్సైట్ కోసం క్రాల్ బడ్జెట్ను కేటాయిస్తాయి, శోధన ఇంజిన్ బోట్ సైట్లో క్రాల్ చేసే పేజీల సంఖ్య. అసంబద్ధమైన లేదా తక్కువ ముఖ్యమైన విభాగాలను అనుమతించకుండా చేయడం ద్వారా, robots.txt ఈ క్రాల్ బడ్జెట్ను ఆప్టిమైజ్ చేయడంలో సహాయపడుతుంది, మరింత ముఖ్యమైన పేజీలు క్రాల్ చేయబడి, సూచిక చేయబడేలా చేస్తుంది.

- మెరుగైన వెబ్సైట్ లోడ్ సమయం: అప్రధానమైన వనరులను యాక్సెస్ చేయకుండా బాట్లను నిరోధించడం ద్వారా, robots.txt సర్వర్ లోడ్ను తగ్గిస్తుంది, SEOలో కీలకమైన అంశం అయిన సైట్ యొక్క లోడ్ సమయాన్ని సమర్థవంతంగా మెరుగుపరుస్తుంది.

- పబ్లిక్ కాని పేజీల ఇండెక్సింగ్ను నిరోధించడం: ఇది పబ్లిక్ కాని ప్రాంతాలను (స్టేజింగ్ సైట్లు లేదా డెవలప్మెంట్ ఏరియాలు వంటివి) ఇండెక్స్ చేయకుండా మరియు శోధన ఫలితాల్లో కనిపించకుండా ఉంచడంలో సహాయపడుతుంది.

Robots.txt ముఖ్యమైన ఆదేశాలు మరియు వాటి ఉపయోగాలు

- అనుమతించు: క్రాలర్లు సైట్లోని ఏ పేజీలు లేదా విభాగాలను యాక్సెస్ చేయాలో పేర్కొనడానికి ఈ ఆదేశం ఉపయోగించబడుతుంది. ఉదాహరణకు, ఒక వెబ్సైట్ SEO కోసం ప్రత్యేకంగా సంబంధిత విభాగాన్ని కలిగి ఉంటే, 'అనుమతించు' ఆదేశం అది క్రాల్ చేయబడిందని నిర్ధారిస్తుంది.

Allow: /public/- అనుమతించవద్దు: 'అనుమతించు'కి వ్యతిరేకం, ఈ ఆదేశం వెబ్సైట్లోని కొన్ని భాగాలను క్రాల్ చేయవద్దని శోధన ఇంజిన్ బాట్లను నిర్దేశిస్తుంది. లాగిన్ పేజీలు లేదా స్క్రిప్ట్ ఫైల్ల వంటి SEO విలువ లేని పేజీలకు ఇది ఉపయోగపడుతుంది.

Disallow: /private/- వైల్డ్కార్డ్లు: నమూనా సరిపోలిక కోసం వైల్డ్కార్డ్లు ఉపయోగించబడతాయి. నక్షత్రం (*) అక్షరాల యొక్క ఏదైనా క్రమాన్ని సూచిస్తుంది మరియు డాలర్ గుర్తు ($) URL ముగింపును సూచిస్తుంది. విస్తృత శ్రేణి URLలను పేర్కొనడానికి ఇవి ఉపయోగపడతాయి.

Disallow: /*.pdf$- సైట్మ్యాప్లు: robots.txtలో సైట్మ్యాప్ లొకేషన్తో సహా శోధన ఇంజిన్లు సైట్లోని అన్ని ముఖ్యమైన పేజీలను కనుగొనడంలో మరియు క్రాల్ చేయడంలో సహాయపడుతుంది. ఇది SEO కోసం కీలకమైనది ఎందుకంటే ఇది సైట్ యొక్క వేగవంతమైన మరియు మరింత పూర్తి సూచికలో సహాయపడుతుంది.

Sitemap: https://martech.zone/sitemap_index.xmlRobots.txt అదనపు ఆదేశాలు మరియు వాటి ఉపయోగాలు

- యూజర్-ఏజెంట్: నియమం ఏ క్రాలర్కు వర్తిస్తుందో పేర్కొనండి. 'యూజర్-ఏజెంట్: *' అన్ని క్రాలర్లకు నియమాన్ని వర్తింపజేస్తుంది. ఉదాహరణ:

User-agent: Googlebot- Noindex: ప్రామాణిక robots.txt ప్రోటోకాల్లో భాగం కానప్పటికీ, కొన్ని శోధన ఇంజిన్లు అర్థం చేసుకుంటాయి a నోయిండెక్స్ robots.txtలో నిర్దేశించబడిన URLని ఇండెక్స్ చేయకూడదని సూచన.

Noindex: /non-public-page/- క్రాల్-ఆలస్యం: ఈ కమాండ్ క్రాలర్లను మీ సర్వర్కి హిట్ల మధ్య నిర్దిష్ట సమయం వేచి ఉండమని అడుగుతుంది, సర్వర్ లోడ్ సమస్యలు ఉన్న సైట్లకు ఉపయోగపడుతుంది.

Crawl-delay: 10మీ Robots.txt ఫైల్ని ఎలా పరీక్షించాలి

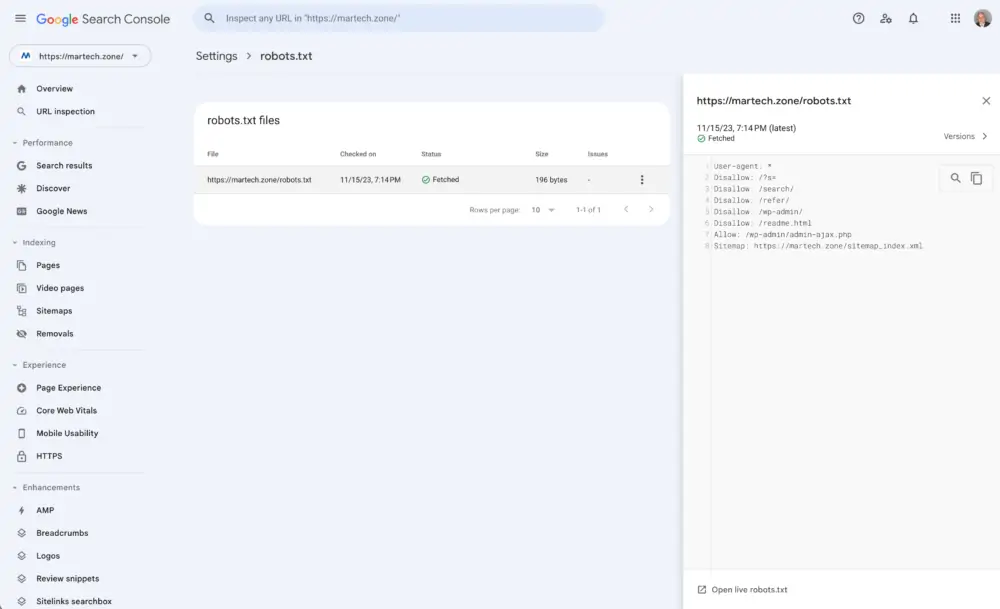

అది పాతిపెట్టబడినప్పటికీ Google శోధన కన్సోల్, శోధన కన్సోల్ robots.txt ఫైల్ టెస్టర్ను అందిస్తుంది.

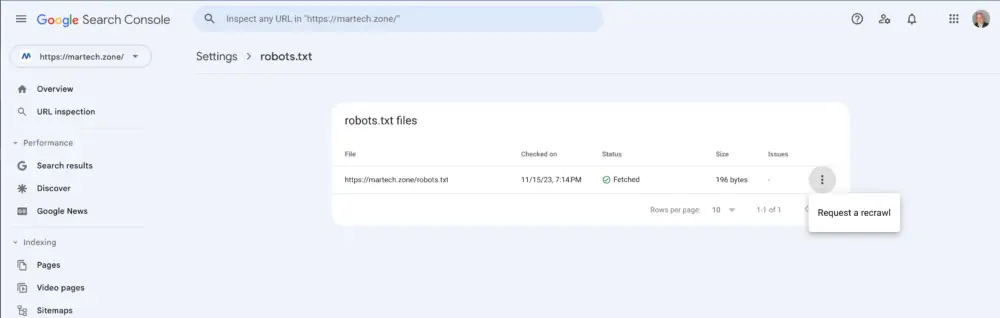

మీరు కుడివైపున ఉన్న మూడు చుక్కలపై క్లిక్ చేసి, ఎంచుకోవడం ద్వారా మీ Robots.txt ఫైల్ను మళ్లీ సమర్పించవచ్చు రీక్రాల్ని అభ్యర్థించండి.

మీ Robots.txt ఫైల్ని పరీక్షించండి లేదా మళ్లీ సమర్పించండి

AI బాట్లను నియంత్రించడానికి Robots.txt ఫైల్ను ఉపయోగించవచ్చా?

లేదో నిర్వచించడానికి robots.txt ఫైల్ ఉపయోగించవచ్చు AI వెబ్ క్రాలర్లు మరియు ఇతర ఆటోమేటెడ్ బాట్లతో సహా బాట్లు మీ సైట్లోని కంటెంట్ను క్రాల్ చేయవచ్చు లేదా ఉపయోగించుకోవచ్చు. ఫైల్ ఈ బాట్లకు మార్గనిర్దేశం చేస్తుంది, అవి వెబ్సైట్లోని ఏ భాగాలను యాక్సెస్ చేయడానికి అనుమతించబడతాయో లేదా అనుమతించబడలేదని సూచిస్తాయి. AI బాట్ల ప్రవర్తనను నియంత్రించే robots.txt ప్రభావం అనేక అంశాలపై ఆధారపడి ఉంటుంది:

- ప్రోటోకాల్కు కట్టుబడి ఉండటం: అత్యంత ప్రసిద్ధ సెర్చ్ ఇంజన్ క్రాలర్లు మరియు అనేక ఇతర AI బాట్లు సెట్ చేసిన నియమాలను గౌరవిస్తాయి

robots.txt. అయితే, ఫైల్ అమలు చేయగల పరిమితి కంటే ఎక్కువ అభ్యర్థన అని గమనించడం ముఖ్యం. బాట్లు ఈ అభ్యర్థనలను విస్మరించగలవు, ప్రత్యేకించి తక్కువ నిగూఢమైన సంస్థలచే నిర్వహించబడేవి. - సూచనల ప్రత్యేకత: మీరు వేర్వేరు బాట్ల కోసం వేర్వేరు సూచనలను పేర్కొనవచ్చు. ఉదాహరణకు, మీరు నిర్దిష్ట AI బాట్లను ఇతరులను అనుమతించకుండా మీ సైట్ను క్రాల్ చేయడానికి అనుమతించవచ్చు. ఇది ఉపయోగించి చేయబడుతుంది

User-agentలో ఆదేశంrobots.txtపైన ఫైల్ ఉదాహరణ. ఉదాహరణకి,User-agent: GooglebotGoogle క్రాలర్ కోసం సూచనలను నిర్దేశిస్తుంది, అయితేUser-agent: *అన్ని బాట్లకు వర్తిస్తుంది. - పరిమితులు: అయితే

robots.txtపేర్కొన్న కంటెంట్ను క్రాల్ చేయకుండా బాట్లను నిరోధించవచ్చు; వారికి ఇప్పటికే తెలిసి ఉంటే అది వారి నుండి కంటెంట్ను దాచదు URL. అదనంగా, కంటెంట్ క్రాల్ చేయబడిన తర్వాత దాని వినియోగాన్ని పరిమితం చేయడానికి ఇది ఏ మార్గాన్ని అందించదు. కంటెంట్ రక్షణ లేదా నిర్దిష్ట వినియోగ పరిమితులు అవసరమైతే, పాస్వర్డ్ రక్షణ లేదా మరింత అధునాతన యాక్సెస్ కంట్రోల్ మెకానిజమ్స్ వంటి ఇతర పద్ధతులు అవసరం కావచ్చు. - బాట్ల రకాలు: అన్ని AI బాట్లు శోధన ఇంజిన్లకు సంబంధించినవి కావు. వివిధ బాట్లు వేర్వేరు ప్రయోజనాల కోసం ఉపయోగించబడతాయి (ఉదా., డేటా అగ్రిగేషన్, అనలిటిక్స్, కంటెంట్ స్క్రాపింగ్). ఈ విభిన్న రకాల బాట్లు REPకి కట్టుబడి ఉన్నంత వరకు యాక్సెస్ని నిర్వహించడానికి robots.txt ఫైల్ కూడా ఉపయోగించబడుతుంది.

మా robots.txt AI బాట్ల ద్వారా సైట్ కంటెంట్ని క్రాల్ చేయడం మరియు ఉపయోగించడం గురించి మీ ప్రాధాన్యతలను సూచించడానికి ఫైల్ సమర్థవంతమైన సాధనంగా ఉంటుంది. అయినప్పటికీ, దాని సామర్థ్యాలు కఠినమైన యాక్సెస్ నియంత్రణను అమలు చేయడం కంటే మార్గదర్శకాలను అందించడానికి పరిమితం చేయబడ్డాయి మరియు దాని ప్రభావం రోబోట్ల మినహాయింపు ప్రోటోకాల్తో బాట్ల సమ్మతిపై ఆధారపడి ఉంటుంది.

robots.txt ఫైల్ SEO ఆయుధాగారంలో ఒక చిన్న కానీ శక్తివంతమైన సాధనం. సరిగ్గా ఉపయోగించినప్పుడు ఇది వెబ్సైట్ యొక్క దృశ్యమానతను మరియు శోధన ఇంజిన్ పనితీరును గణనీయంగా ప్రభావితం చేస్తుంది. సైట్లోని ఏ భాగాలు క్రాల్ చేయబడి, సూచిక చేయబడతాయో నియంత్రించడం ద్వారా, వెబ్మాస్టర్లు వారి అత్యంత విలువైన కంటెంట్ హైలైట్ చేయబడి, వారి SEO ప్రయత్నాలను మరియు వెబ్సైట్ పనితీరును మెరుగుపరుస్తారు.